Публикация 8 мая 2026

Обновление 8 мая 2026

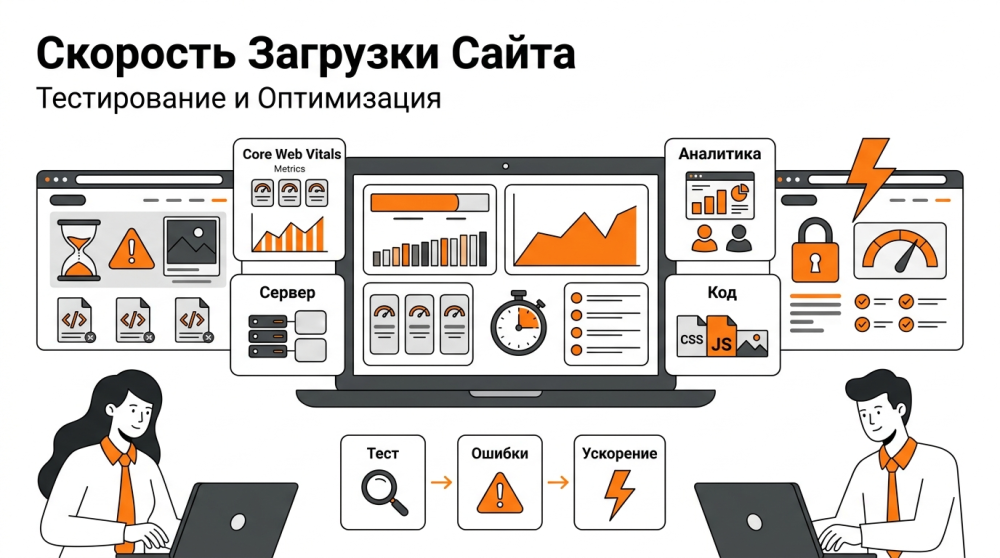

Каждая лишняя секунда ожидания обходится бизнесу дороже, чем принято думать. Пользователь не анализирует причины задержки – он просто закрывает вкладку и открывает сайт конкурента. Сегодня быстрый сайт – это уже не конкурентное преимущество, а базовое требование рынка: поисковые системы прямо учитывают скорость загрузки в алгоритмах ранжирования, а аудитория становится всё менее терпимой к любым задержкам. В этой статье разберём, как объективно оценить производительность ресурса, какие инструменты дают наиболее точную картину и где искать главные точки роста.

Что такое скорость загрузки сайта и почему она важна?

Прежде чем переходить к инструментам и оптимизации, важно разобраться в самих метриках. Без понимания того, что именно измеряется, любые цифры в отчётах остаются просто числами.

Основные метрики Core Web Vitals (LCP, FID/INP, CLS)

Google официально включил Core Web Vitals в алгоритм ранжирования в 2021 году, и с тех пор эти три показателя стали индустриальным стандартом оценки пользовательского опыта.

LCP (Largest Contentful Paint) – время отрисовки самого крупного видимого элемента: главного изображения, заголовка или блока текста. Именно этот момент пользователь воспринимает как «страница загрузилась». Хороший показатель – до 2,5 секунды.

INP (Interaction to Next Paint) – метрика, пришедшая на смену FID в 2024 году. Она измеряет задержку между любым взаимодействием пользователя (кликом, нажатием клавиши) и визуальным откликом интерфейса. Норма – менее 200 мс.

CLS (Cumulative Layout Shift) – совокупное смещение макета в процессе загрузки. Если кнопка «перепрыгивает» и пользователь случайно нажимает не туда, CLS высокий. Допустимое значение – менее 0,1.

Важно понимать: эти три метрики оцениваются не в вакууме, а по реальным данным пользователей из Chrome User Experience Report (CrUX), что делает их особенно значимыми для SEO.

Какую скорость загрузки считать нормой в 2026 году?

Универсального эталона не существует – нормы зависят от типа устройства и ниши. Тем не менее отраслевые данные позволяют очертить чёткие ориентиры.

|

Тип устройства |

Хороший результат |

Приемлемый |

Требует оптимизации |

|

Мобильный (4G) |

до 1,5-2 с |

2-3 с |

более 3 с |

|

Десктоп |

менее 1 с |

1-2 с |

более 2 с |

|

Интернет-магазин |

до 2 с |

2-3,5 с |

более 3,5 с |

Для мобильного сегмента планка жёстче: большинство пользователей не готовы ждать дольше двух секунд, особенно при переходе из поисковой выдачи. Порталы с тяжёлой функциональностью (фильтры, динамические каталоги) могут допускать чуть более мягкие показатели, но только при условии правильного приоритета загрузки контента.

Влияние быстродействия на индексацию и ранжирование

Медленный ответ сервера напрямую сокращает краулинговый бюджет. Если Googlebot тратит секунды на ожидание каждой страницы, он обходит меньше URL за один визит – новый контент попадает в индекс с задержкой. Для крупных сайтов с тысячами страниц это критично.

Яндекс в официальной документации указывает, что время ответа сервера влияет на качество индексации. Ресурсы с TTFB (Time to First Byte) выше 500 мс реже попадают в блок быстрых ответов и теряют позиции при равенстве остальных факторов.

Взаимосвязь времени отрисовки и коэффициента конверсии

Маркетинговые отчеты показывают, что ускорение мобильной загрузки всего на десятые доли секунды способно заметно увеличить конверсию в продажу. Кажется, что доля секунды – это совсем немного, но в масштабах реального трафика она дает ощутимый прирост выручки.

Психологически «белый экран» воспринимается пользователем как сигнал неисправности или ненадёжности ресурса. Человек не ждёт технического объяснения – он просто уходит к конкуренту. При этом вернуть его будет значительно сложнее.

Сервисы для проверки скорости загрузки сайта

Рынок инструментов диагностики разнообразен: от простых экспресс-анализаторов до профессиональных систем с детальной трассировкой запросов. Выбор зависит от задачи и уровня технической экспертизы.

Google PageSpeed Insights: анализ лабораторных и полевых данных

Это отправная точка для любого аудита. Сервис объединяет два принципиально разных источника информации.

Полевые данные (Field Data) берутся из реальной статистики Chrome за последние 28 дней. Они отражают опыт ваших живых пользователей с их реальными устройствами и соединениями. Именно эти данные учитываются в алгоритме Google.

Лабораторные данные (Lab Data) генерируются движком Lighthouse в контролируемых условиях. Они воспроизводимы и полезны для отладки: можно сравнивать «до» и «после» внесённых изменений.

Один из типичных кейсов: сайт набирает 78 баллов в лаборатории, но имеет красный LCP в полевых данных – из-за медленного хостинга в регионах с высокой латентностью. Без понимания разницы между источниками данных этот нюанс легко пропустить.

WebPageTest: глубокий технический аудит и Waterfall-диаграммы

Инструмент для тех, кто хочет разобраться в причинах, а не просто увидеть итоговый балл. Waterfall-диаграмма отображает каждый сетевой запрос в хронологическом порядке: когда начался, сколько длился, что заблокировало следующий ресурс.

Именно здесь можно обнаружить, что один внешний скрипт аналитики блокирует отрисовку страницы на 800 мс. Или что шрифт загружается последним, хотя он нужен для отрисовки заголовка.

WebPageTest позволяет выбирать локацию сервера, тип браузера и скорость соединения, что делает его незаменимым для диагностики региональных проблем с загрузкой.

Pingdom Tools: оценка производительности из разных регионов

Сильная сторона Pingdom – возможность запустить тест из Европы, США или Азии в один клик. Если ваш сервер физически расположен в Москве, пользователи из Лондона или Сингапура получат страницу заметно медленнее.

Отчёт по размеру контента (Content Size by Content Type) наглядно показывает, что «съедает» больше всего ресурсов. Нередко оказывается, что 70–80% веса страницы составляют изображения, а не код, – и именно с них стоит начинать оптимизацию.

GTmetrix: комплексные отчёты и история изменений

GTmetrix особенно удобен при работе в команде и долгосрочном мониторинге. Сервис сохраняет историю тестов, и вы можете визуально отследить, как обновление плагина или смена хостинга повлияли на производительность.

Вкладка Structure анализирует качество вёрстки: неиспользуемый CSS, блокирующие скрипты, отсутствие lazy loading. Performance транслирует данные Lighthouse в понятные рекомендации с указанием потенциального выигрыша в секундах.

Loading.Express и PR-CY: русскоязычные экспресс-анализаторы

Для быстрой диагностики без погружения в технические дебри удобны отечественные сервисы. Loading.Express даёт понятные рекомендации на русском языке – это особенно ценно, когда нужно объяснить проблему клиенту или нетехническому коллеге.

PR-CY и Sitespeed позволяют провести массовую проверку страниц и получить чек-лист ошибок по всему сайту, что актуально при техническом аудите перед продвижением.

UpTrends и mobiReady: проверка мобильной адаптивности

Отдельного внимания заслуживают инструменты, эмулирующие мобильные условия. mobiReady тестирует производительность при подключении 3G и 4G, имитируя реальный сценарий пользователя в дороге.

UpTrends дополнительно проверяет рендеринг интерфейса на разных диагоналях экранов, выявляя проблемы с горизонтальной прокруткой, перекрывающимися элементами и мелким текстом – всё то, что ухудшает мобильный UX и негативно влияет на поведенческие факторы.

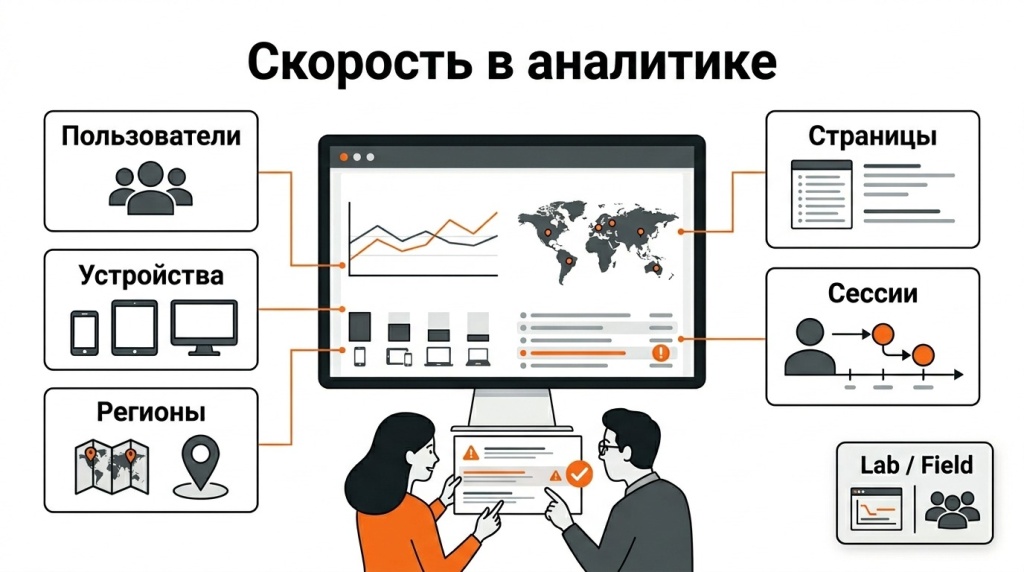

Проверка скорости через инструменты веб-аналитики

Синтетические тесты показывают потенциал, а аналитические данные – реальность. Использовать только один тип инструментов означает работать с неполной картиной.

Отчёты о производительности в Google Analytics 4

В GA4 данные о скорости доступны через интеграцию с Search Console и прямые события. Чтобы получить статистику по времени загрузки, настройте пользовательские события или подключите Google Tag Manager с триггером на метрику LCP.

Реальные данные пользователей часто расходятся с лабораторными на 20-40%. Если PageSpeed Insights показывает 85 баллов, а GA4 фиксирует высокий процент сессий с медленной загрузкой – проблема может быть локализована в конкретном регионе или на конкретном типе устройств.

Мониторинг времени ответа сервера в Яндекс.Метрике

Метрика содержит отдельный раздел «Время загрузки страниц», где можно сегментировать данные по устройствам, браузерам и регионам. Именно здесь часто обнаруживается, что у пользователей из Сибири или Дальнего Востока страницы загружаются на 1,5-2 секунды дольше, чем у московских – из-за географической удалённости от сервера.

Раздел «Скорость загрузки» в Яндекс.Вебмастере

Яндекс.Вебмастер агрегирует данные по времени ответа сервера и показывает общий статус в сравнении с конкурентами в нише. Здесь же отображается информация по турбо-страницам – облегчённым версиям для мобильных пользователей, которые Яндекс приоритизирует в мобильной выдаче.

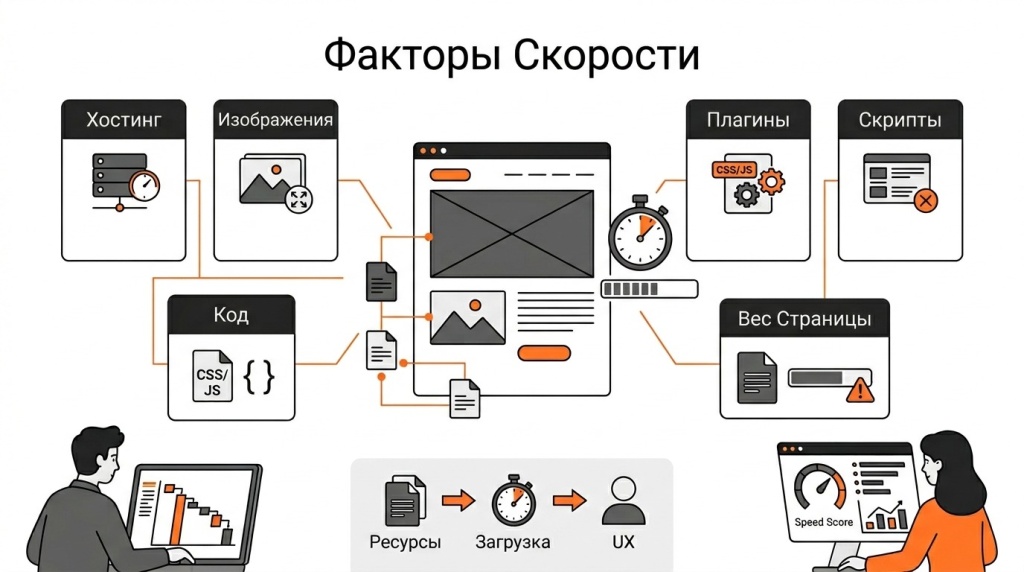

Факторы, влияющие на скорость загрузки страниц

Понимание первопричин важнее знания симптомов. Оптимизация «по верхам» даёт временный эффект; системное ускорение требует работы с корневыми факторами.

Технические параметры сервера и качество хостинга

TTFB – время до получения первого байта от сервера – это фундамент всего. Даже идеально оптимизированная фронтенд-часть не спасёт, если сервер отвечает 900 мс.

Дешёвый виртуальный хостинг с сотнями соседних сайтов на одном физическом сервере – классическое узкое место системы. В часы пиковой нагрузки TTFB может вырастать в 3-4 раза. Переход на VPS/VDS с выделенными ресурсами нередко даёт прирост производительности без каких-либо изменений в коде.

Версия PHP и конфигурация базы данных

Программная среда влияет на скорость не меньше, чем железо. Тесты производительности от Phoronix показывают, что PHP 8.3 обрабатывает запросы значительно быстрее, чем PHP 7.4 – в первую очередь за счёт JIT-компиляции и оптимизаций ядра. При этом многие сайты до сих пор работают на устаревших версиях.

Не менее важна оптимизация базы данных: индексирование таблиц, удаление устаревших ревизий в WordPress, оптимизация медленных запросов через EXPLAIN в MySQL. Запрос без индекса на таблице из 100 000 строк может занимать секунды вместо миллисекунд.

Влияние CMS и избыточных плагинов на производительность

Каждый активный плагин в WordPress генерирует дополнительные запросы к БД, подключает свои CSS и JS, а нередко ещё и «встревает» в хуки, замедляя генерацию страницы. Сайт с 40 активными плагинами практически гарантированно будет медленнее аналогичного с 15.

В 1С-Битрикс ситуацию усугубляет тяжёлая архитектура компонентов: каждый компонент по умолчанию делает собственные обращения к данным, даже если нужная информация уже была получена ранее.

Общий вес страницы и количество HTTP-запросов

Простая арифметика: браузер запрашивает каждый файл отдельно. Страница с 80 ресурсами (изображения, стили, скрипты, шрифты) создаёт 80 отдельных HTTP-запросов. Если сервер не поддерживает протокол HTTP/2, браузеру придётся открывать множество раздельных TCP-соединений, из-за чего даже при быстром интернете накладные расходы на их установку окажутся ощутимыми.

Практический ориентир для большинства проектов:

-

Общий вес страницы – до 1,5-2 МБ

-

Количество HTTP-запросов – до 50-60

-

Размер HTML-документа – до 100 КБ

Сторонние скрипты, виджеты и рекламные блоки

Это одна из наиболее недооценённых причин замедления. Каждый внешний скрипт – онлайн-чат, пиксель соцсети, система аналитики – делает запрос к стороннему серверу. Если этот сервер отвечает медленно или недоступен, браузер ждёт его ответа, блокируя отрисовку основного контента.

Проверить влияние сторонних ресурсов легко: запустите тест в WebPageTest и отфильтруйте запросы по доменам. Нередко обнаруживается, что 30-40% суммарного времени загрузки приходится именно на внешние скрипты.

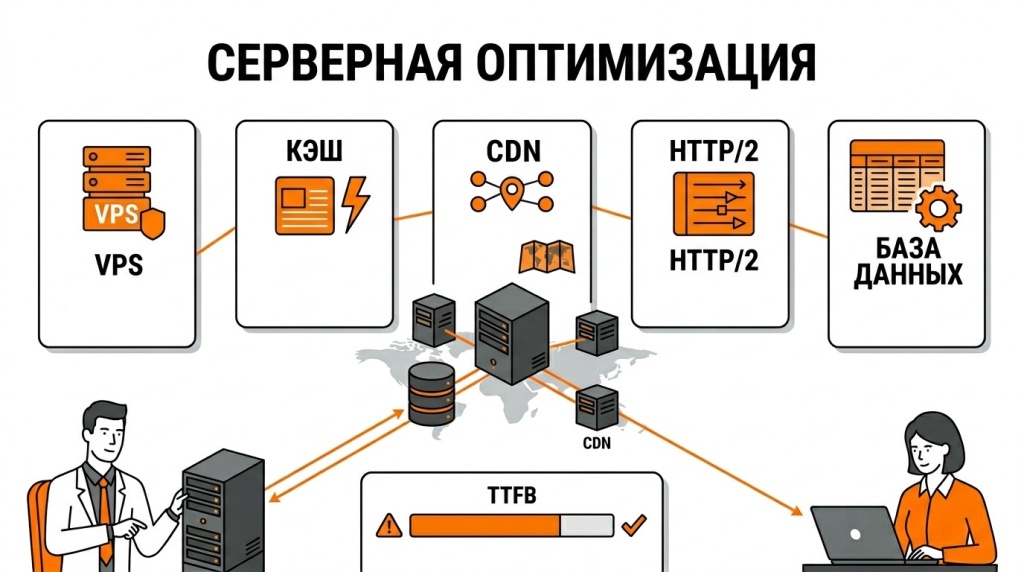

Как ускорить загрузку сайта: серверная оптимизация

Серверная часть задаёт потолок производительности. Клиентская оптимизация помогает приблизиться к нему, но не преодолеть.

Выбор типа хостинга: от Shared до VPS/VDS

Для сайтов с трафиком до 1000 уникальных посетителей в сутки качественного shared-хостинга обычно достаточно. При росте нагрузки переход на VPS становится необходимостью: выделенные CPU и RAM исключают влияние соседних ресурсов на вашу производительность.

Для высоконагруженных интернет-магазинов и порталов оптимальна схема с выделенным сервером базы данных и отдельным сервером приложений – это позволяет масштабировать каждую часть независимо.

Настройка кэширования на стороне сервера

Серверное кэширование – один из наиболее эффективных методов оптимизации по соотношению усилий и результата. Технологии Redis и Memcached хранят часто запрашиваемые данные в оперативной памяти, полностью исключая обращения к БД при повторных запросах.

FastCGI Cache на уровне Nginx идёт дальше: он кэширует уже готовую HTML-страницу и отдаёт её пользователям напрямую, минуя PHP и базу данных. TTFB в таком случае может опускаться до 20-50 мс.

Использование современных протоколов HTTP/2 и HTTP/3

HTTP/1.1 обрабатывает запросы последовательно: пока не получен ответ на один файл, следующий не запрашивается. HTTP/2 решает эту проблему через мультиплексирование – десятки файлов загружаются параллельно в одном TCP-соединении.

HTTP/3 (QUIC) идёт ещё дальше, устраняя проблему «head-of-line blocking» на транспортном уровне. Для пользователей с нестабильным соединением, например на мобильных устройствах, выигрыш может быть весьма заметным.

Подключение CDN для ускорения доставки контента

Статические файлы – изображения, CSS, JavaScript – можно отдавать с сервера, физически расположенного рядом с пользователем. CDN-провайдеры (Cloudflare, Akamai, AWS CloudFront) имеют узлы во всех крупных регионах мира.

Для мультирегионального бизнеса CDN – это не опция, а необходимость. Разница в TTFB между пользователем в Новосибирске, получающим файл с московского сервера, и тем же пользователем, получающим его с ближайшего CDN-узла, может составлять 200-400 мс на каждый ресурс.

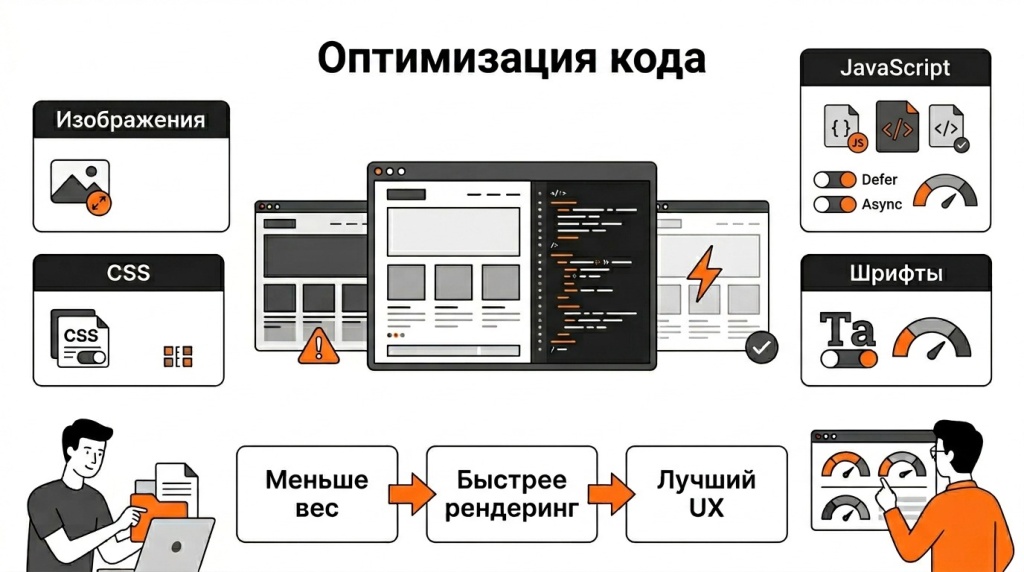

Клиентская оптимизация и работа с кодом

После серверной части приходит очередь фронтенда. Именно здесь чаще всего скрыт наибольший потенциал ускорения без изменения инфраструктуры.

Сжатие и изменение формата изображений

Изображения составляют в среднем 60-65% веса типичной страницы. Переход на форматы нового поколения даёт ощутимый результат: файлы WebP в среднем на 30% меньше по размеру, чем JPEG при сопоставимом качестве, а AVIF – на 50% меньше.

Автоматизировать процесс помогают инструменты Squoosh, ImageOptim или серверные библиотеки (libvips, Sharp). Важно также внедрить lazy loading – загрузку изображений только при попадании в видимую область экрана.

Оптимизация критического пути: работа с CSS и JavaScript

Браузер не может отрисовать страницу, пока не загрузит и не обработает все CSS, подключённые в <head>. Минификация (удаление пробелов и комментариев) и конкатенация файлов сокращают объём и количество запросов.

Для JavaScript критичны атрибуты defer и async. Скрипт с defer загружается параллельно, но выполняется только после парсинга HTML. async загружается и выполняется сразу – подходит для независимых скриптов. Правильное применение этих атрибутов может полностью исключить блокировку рендера.

Настройка шрифтов и предотвращение блокировки отрисовки

Проблема FOIT (Flash of Invisible Text) возникает, когда браузер ждёт загрузки шрифта и не показывает текст вообще. Решение – директива font-display: swap в CSS: браузер сначала отображает текст системным шрифтом, а затем плавно заменяет его целевым.

Дополнительный выигрыш даёт хранение шрифтов на собственном сервере вместо загрузки с Google Fonts: исключается лишний DNS-запрос и установка соединения с внешним доменом.

Рекомендации по ускорению для популярных движков

Универсальные принципы оптимизации работают везде, но каждая CMS имеет собственную архитектуру, узкие места и проверенные инструменты решения. Разберём конкретные шаги для трёх наиболее распространённых платформ в русскоязычном сегменте.

Особенности оптимизации сайтов на WordPress

WordPress – самая распространённая CMS, и одновременно одна из наиболее уязвимых к замедлению. Базовый стек оптимизации включает:

-

WP Rocket – кэширование страниц, минификация CSS/JS, отложенная загрузка изображений

-

Autoptimize – агрегация и минификация кода

-

EWWW Image Optimizer – автоматическое сжатие изображений при загрузке

-

Query Monitor – диагностика медленных запросов к БД

Тема оформления влияет не меньше, чем плагины. Лёгкие темы (GeneratePress, Kadence) создают в 2-3 раза меньше HTTP-запросов, чем перегруженные «мультифункциональные» конструкторы.

Улучшение производительности в 1С-Битрикс

Битрикс имеет встроенный «Монитор производительности», который выявляет тяжёлые компоненты и медленные SQL-запросы. Первый шаг – изучение его отчётов перед любой другой оптимизацией.

Ключевой инструмент ускорения – «Композитный сайт»: технология кэширует статическую часть страницы и динамически подгружает только персонализированные блоки (корзина, личный кабинет). Это позволяет добиться TTFB менее 100 мс даже на нагруженных проектах.

Советы для интернет-магазинов на OpenCart

В OpenCart основные проблемы производительности концентрируются в разделах каталога с большим числом товаров. Каждый фильтр генерирует новый SQL-запрос; без кэширования страниц категорий и оптимизации индексов базы данных время ответа растёт пропорционально ассортименту.

Рекомендуется также вынести обработку фильтров на уровень Elasticsearch или Sphinx – это снимает нагрузку с MySQL и даёт стабильное время ответа независимо от числа SKU.

Шпаргалка по мониторингу и сохранению результатов

Оптимизация без последующего мониторинга – это работа вхолостую. Новый плагин, обновление темы или рост трафика могут свести результаты оптимизации на нет за считаные дни.

Чек-лист регулярной проверки показателей

Еженедельно:

-

Проверить Core Web Vitals в Google Search Console

-

Просмотреть отчёт по скорости в Яндекс.Вебмастере

-

Контролировать TTFB через UptimeRobot или Oh Dear

После каждого обновления:

-

Запустить тест в PageSpeed Insights и GTmetrix

-

Сравнить с базовыми показателями до изменений

-

Проверить Waterfall в WebPageTest на появление новых блокирующих ресурсов

Инструменты для автоматического мониторинга

UptimeRobot в бесплатном тарифе проверяет доступность сайта каждые 5 минут и присылает уведомление в Telegram или на почту при падении. Oh Dear дополнительно контролирует время ответа и SSL-сертификат.

Для команд разработки стоит рассмотреть интеграцию Lighthouse CI в пайплайн: автоматическая проверка производительности при каждом деплое исключает случайные регрессии.

Как закрепить результат после оптимизации?

Введите Performance Budget – задокументированные лимиты на вес страницы и количество запросов. Например: общий вес не более 1,8 МБ, LCP не выше 2 секунд, не более 3 сторонних скриптов. Разработчики обязаны учитывать эти лимиты при добавлении нового функционала.

Итоги

Быстрый сайт – это не технический перфекционизм, а бизнес-инструмент. Данные однозначно подтверждают связь между временем загрузки, поведением пользователей и позициями в выдаче. При этом оптимизация скорости не разовый проект, а непрерывный процесс: веб меняется, браузеры обновляют стандарты, конкуренты не стоят на месте.

Техническое совершенство создаёт условия для роста, но не заменяет качественного контента. Сайт, который загружается за 0,8 секунды, но не даёт пользователю ответа на его вопрос, так же проиграет в долгосрочной перспективе. Работайте над обеими составляющими одновременно – это единственный путь к устойчивым позициям в топе.